KI im ITSM des Gesundheitswesens: Der stille DSGVO-Risikomultiplikator, den Sie nicht ignorieren sollten

Inhaltsverzeichnis

Organisationen im Gesundheitswesen teilen eine grundlegende Wahrheit: Vertrauen ist das Fundament der Patientenversorgung. Patient*innen teilen ihre hochsensible Informationen, darunter Symptome, Diagnosen, Behandlungen und Gewohnheiten. Sie vertrauen darauf, dass diese geschützt werden. Und in den heutigen digitalen Krankenhäusern liegt dieses Vertrauen zunehmend bei den Technologieteams, die klinische Systeme, vernetzte medizinische Geräte und die Service Management-Plattformen verwalten, die alles am Laufen halten.

IT Service Management (ITSM) liefert zwar keine direkte Versorgung, fungiert jedoch als leiser Motor, der die Versorgungsumgebung im Hintergrund antreibt. Die Wiederherstellung einer Arbeitsstation gibt einer Pflegekraft mitten in der Schicht wieder Zugang zu Medikationsdaten. Eine Viewer-Integration bringt Röntgenbilder in den diagnostischen Workflow. Ein Konfigurations-Update für eine mobile Gesundheits-App stellt sicher, dass Kliniker*innen sicher auf Patientendaten zugreifen können. Hinter jedem dieser Workflows stecken Gesundheitsdaten, und das macht ITSM zu einer Hochrisiko-Verarbeitungsumgebung im Sinne der DSGVO. Für CIOs, IT-Betriebsleiter und Entscheidungsträger für IT im Gesundheitswesen ist das keine Neuigkeit. Was jedoch neu ist, ist die Geschwindigkeit, mit der sich das Umfeld verändert.

- IT-Teams im Gesundheitswesen unterstützen mobile Gesundheits-Apps, und 44 % dieser Apps teilen personenbezogene Daten mit Dritten, oft ohne dies angemessen offenzulegen.

- Wearables und Remote-Care-Plattformen erzeugen Standort- und Verhaltenssignale, und eine Studie zeigt, dass 95 % der Personen anhand von nur vier Standortpunkten identifiziert werden können.

- ITSM-Plattformen speichern nicht nur direkte Identifikatoren. Sie erzeugen auch Gesundheitsinferenzdaten: Wer auf Onkologiesysteme zugegriffen hat, wer Vorfälle in psychiatrischen Anwendungen gemeldet hat, welche Geräte mit welchen Stationen verbunden sind.

Kommen Ransomware-Risiken, Integrationswildwuchs und veraltete Infrastruktur hinzu, gehören „routinemäßige” ITSM-Vorgänge plötzlich zu den risikoreichsten Verarbeitungsaktivitäten, die eine Gesundheitsorganisation durchführt.

Ein wesentlicher Faktor, der diese Risiken in Gesundheitsorganisationen beschleunigt, ist der rasante Aufstieg von KI und Automatisierung

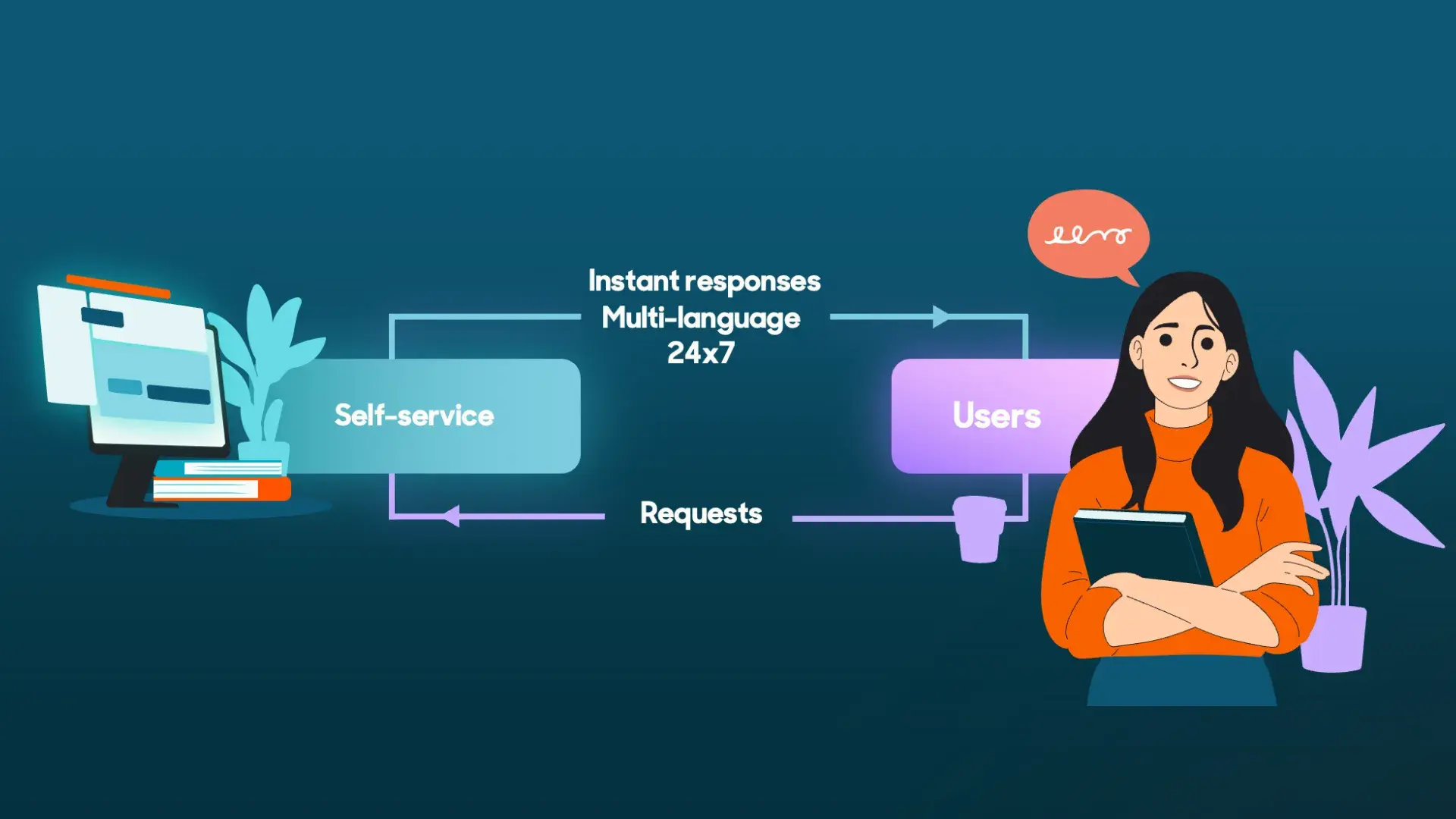

Teams betrachten Künstliche Intelligenz häufig nur im Hinblick auf operative Effizienz. Sie sehen KI als Möglichkeit, Anfragen schneller zu triagieren, Tickets automatisch anzureichern oder Rückstände abzubauen. Aber KI optimiert nicht einfach bestehende Workflows. Sie verändert, wie Daten sich bewegen, wie Entscheidungen getroffen werden und wie Gesundheitsinferenzdaten entstehen. Diese Transformation multipliziert sowohl Nutzen als auch Risiko.

Eine Zukunft, in der KI Compliance und operative Leistung stärkt, ist erreichbar. Doch dafür ist ein neuer Ansatz bei Datenschutz-Folgenabschätzungen (DSFA), Automatisierungspraktiken und KI-Governance erforderlich. Organisationen, die dies gut umsetzen, schaffen eine sicherere und widerstandsfähigere ITSM-Umgebung. Jene, die es nicht tun, werden vermeidbare Vorfälle, regulatorische Kontrolle und den Vertrauensverlust der Patient*innen erleben.

Hier finden IT-Verantwortliche die erforderlichen Änderungen samt Leitfaden für eine sichere Umsetzung:

Datenschutz-Folgenabschätzungen müssen ein fester Bestandteil jedes KI- und Automatisierungsprojekts sein

KI im ITSM des Gesundheitswesens führt zu neuen Datenflüssen, Profilierungsrisiken und Mustern automatisierter Entscheidungsfindung. Nach der DSGVO stuft dies die meisten KI-gestützten ITSM-Aktivitäten als hochriskante Verarbeitungsaktivitäten ein, wodurch Datenschutz-Folgenabschätzungen verpflichtend werden.

Eine DSFA ist ein strukturierter Prozess, der aufzeigt, welche Risiken entstehen, wie Rechte und Freiheiten beeinträchtigt werden könnten und welche Kontrollmaßnahmen hinzugefügt werden müssen. Im Gesundheitswesen setzen viele IT-Teams KI-Routing, Chatbots oder Analysen ohne eine DSFA ein, weil diese Projekte nicht wie traditionelle Gesundheitsdatensysteme aussehen.

Praktische Umsetzung:

- Datenschutz-Folgenabschätzungen in das Änderungsmanagement integrieren

- Eine DSFA für jedes KI-System, jede Automatisierungsinitiative, Datenmigration, neue Integration oder Analyse-Deployment einfordern

- Den Datenschutzbeauftragten frühzeitig einbeziehen und Verarbeitungszwecke und Datenflüsse, Notwendigkeit und Verhältnismäßigkeit sowie Risiken für Rechte und Freiheiten dokumentieren

Automatisierung sollte Compliance stärken, nicht schwächen

Automatisierung kann im ITSM des Gesundheitswesens ein starkes Compliance-Werkzeug sein. Manuelle DSGVO-Kontrollen sind nicht skalierbar. Daher sind Klassifizierung, Aufbewahrungsprüfungen, Zugriffsprüfungen und das Erkennen von Datenschutzverletzungen anfällig für Inkonsistenz, wenn sie manuell durchgeführt werden.

Bei sorgfältiger Implementierung bietet die Automatisierung eine wirksame Lösung für diese Herausforderungen. Automatisierte Datenklassifizierung und -tagging verbessert die Präzision, automatisierte Tools zur Überprüfung von Zugriffsrechten helfen dabei, schleichende Rechteausweitung (Privilege Creep) früher zu erkennen, und SIEM-Tools zur Erkennung von Sicherheitsverletzungen verkürzen die Zeit, die benötigt wird, um Vorfälle aufzudecken.

Praktische Umsetzung:

- Automatisierung für Bereiche priorisieren, die am anfälligsten für Abweichungen sind

- Automatisierte Datenklassifizierung und -tagging, Aufbewahrungsdurchsetzung, automatisierte Zugriffsprüfungen und Vorfall-Eskalation einsetzen

- Automatisierung nutzen, um sicherzustellen, dass Prozesse stets der Richtlinie folgen

KI erfordert kontinuierliche Governance, Überwachung und Transparenz

KI-Systeme entwickeln sich weiter, unterliegen Modell-Drift und verhalten sich je nach Trainingsdaten, Updates oder unvorhergesehenen Korrelationen unterschiedlich. Im ITSM des Gesundheitswesens können diese Systeme besondere Kategorien von Daten verarbeiten oder ableiten. Ohne Governance kann KI zu Diskriminierung, inkonsistenten Ergebnissen oder undurchsichtigen Entscheidungen führen.

Nach der DSGVO müssen Organisationen sicherstellen, dass automatisierte Entscheidungen, die Einzelpersonen betreffen, transparent sind, menschlicher Kontrolle unterliegen und kontinuierlich überwacht werden. Es ist unerlässlich, Bias in Trainingsdaten und Ergebnissen zu identifizieren und zu beheben. Gleichzeitig müssen die für das KI-Training verwendeten Daten gemäß Datenschutzanforderungen strikt minimiert werden. Diese Verantwortung bleibt auch dann bestehen, wenn KI für routinemäßige operative Prozesse eingesetzt wird.

Praktische Umsetzung:

- Verantwortlichkeit für jedes KI-Modell festlegen

- Zweck, Trainingsdaten, Logik und Einschränkungen dokumentieren

- Monatlich auf Drift oder diskriminierende Ergebnisse überwachen

- Menschliche Überprüfung automatisierter Entscheidungen sicherstellen, beispielsweise durch einen Antragsprozess

KI-Adoption erfordert neue Formen der Datenminimierung

KI profitiert von Datenvolumen, aber die DSGVO verlangt Zweckbindung und Minimierung bei Datensätzen, die der KI als Quelle zur Verfügung stehen. Teams im Gesundheitswesen gehen oft davon aus, dass mehr Daten die Genauigkeit verbessern, aber unnötige Daten erhöhen das Risiko.

Minimierung stärkt sowohl den Datenschutz als auch die Modellleistung, wenn sie korrekt durchgeführt wird. Dazu gehören das Entfernen unnötiger Identifikatoren, die Verwendung synthetischer Daten für Tests und die Dokumentation, wofür ein Datensatzattribut benötigt wird.

Praktische Umsetzung:

- Datensätze für KI-Verwendung auf das Nötigste beschränken

- Aufbewahrungszeiten begrenzen und synthetische Daten verwenden, wo möglich

- Jedes Datenattribut als potenziellen Inferenzvektor behandeln und begründen

Die Zukunft von KI im ITSM für Gesundheitswesen hängt von Governance ab, nicht von Spekulationen

KI wird das ITSM im Gesundheitswesen weiter beschleunigen: die Effizienz steigern, die Problemlösung beschleunigen und den klinischen Support modernisieren. Aber KI verändert auch die Art, wie sensible Daten verarbeitet werden, was neue Verpflichtungen rund um Datenschutz-Folgenabschätzungen, Automatisierungsaufsicht, Erklärbarkeit und Minimierung schafft.

Organisationen, die diese Praktiken erfolgreich umsetzen, werden KI selbstbewusst und regelkonform skalieren. Sie reduzieren manuelle Arbeitslast, verbessern den Datenschutz der Patient*innen und schaffen ein widerstandsfähiges digitales Fundament für die moderne Versorgung. Organisationen, die diese Schritte ignorieren, werden mit vermeidbaren Vorfällen, operativen Verlangsamungen und erhöhter Aufmerksamkeit der Regulierungsbehörden konfrontiert werden.

KI sicher und verantwortungsvoll implementieren – eine Übersicht der wichtigsten Schritte:

- Datenschutz-Folgenabschätzungen als Standardschritt in jedem KI- und Automatisierungsprojekt integrieren

- Automatisierung einsetzen, um Compliance zu stärken, nicht nur um Workflows zu beschleunigen

- Laufende Aufsicht und Erklärbarkeit für jedes KI-System implementieren

- Datenminimierung in jede Trainings- und Verarbeitungspipeline einbauen

Der beste Ausgangspunkt ist zu wissen, wo die ITSM-Umgebung Ihrer Organisation aktuell steht.

Laden Sie die vollständige Healthcare ITSM-Checkliste: 17 kritische Punkte für die GDPR-Compliance herunter

Sie umfasst 17 kritische DSGVO-Compliance-Bereiche im ITSM des Gesundheitswesens - einschließlich der in diesem Artikel behandelten - und bietet Ihnen einen konkreten Ansatz, um einzuschätzen, ob Ihre Einrichtung für KI -gestützte Abläufe bereit ist.

--

Dieser Blog basiert auf Erkenntnissen aus "Guarding Health Data Privacy in Europe: The Limits and Challenges of Current Regulations", veröffentlicht von EDRi.

Matrix42

Inhaltsverzeichnis

Melden Sie sich an, um Tipps und Artikel direkt in Ihren Posteingang

.png)